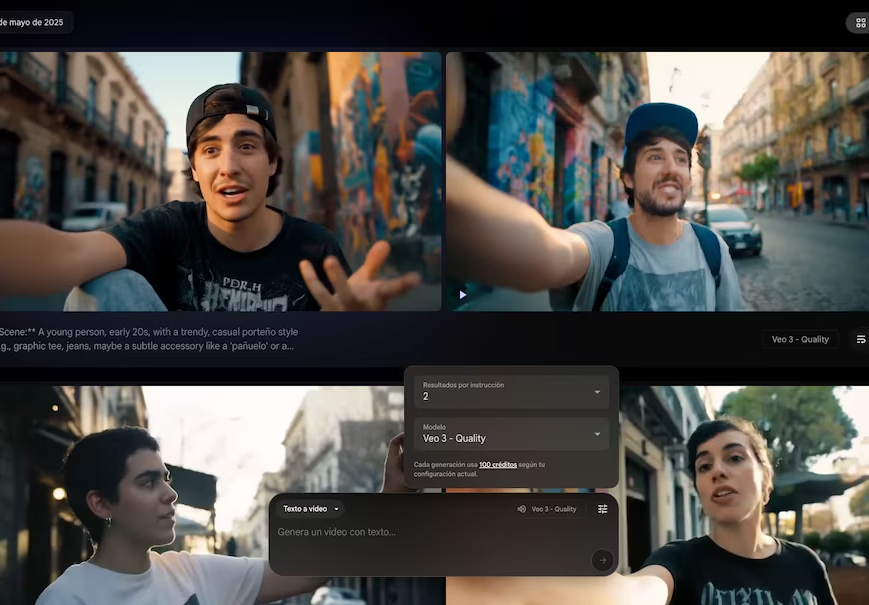

La presentación de Google Veo 3 marcó un cambio en la creación de videos generados por inteligencia artificial. La herramienta permite producir clips hiperrealistas de hasta ocho segundos con audio sincronizado. Este avance generó preocupación en organismos, medios y especialistas.

A diferencia de sus predecesores, como SORA, Movie Gen o ModelScope, Veo 3 mejora la fidelidad visual y la física del entorno, e incluye sonido ambiente y voces. Sin embargo, la facilidad para crear estos contenidos expone riesgos de manipulación digital, según alertaron medios como Time y Quartz.

En su debut, Google Veo 3 se usó para crear un anuncio de la firma Kalshi, difundido en las finales de la NBA. El desarrollo demoró solo dos días. El creador PJ Ace dijo que el costo fue un 95 % menor que el de una producción tradicional.

Riesgos de desinformación con videos generados por IA

Expertos señalan que esta tecnología facilita la creación de noticias falsas. Se reportaron clips manipulados sobre disturbios, conferencias ficticias y figuras públicas. El Departamento de Seguridad de EE.UU. advirtió que los deepfakes no necesitan perfección técnica para ser creíbles.

Nina Brown, de la Universidad de Syracuse, alertó que “el mayor peligro es la erosión de la confianza colectiva en línea”. Margaret Mitchell, de Hugging Face, afirmó que los riesgos incluyen la creación de propaganda o contenidos violentos.

Google Veo 3 aplica marcas de agua y límites

La herramienta impone restricciones para evitar abusos. Bloquea ciertos temas, como violencia o celebridades reconocibles, y marca los videos con SynthID, una firma invisible. Aun así, medios como Time comprobaron que estas medidas pueden eludirse.

Gizmodo informó que la IA de Google amenaza empleos en estudios de efectos visuales. Amazon Studios también confirmó su uso de IA para reducir gastos. Según PC MAG, esto puede reducir costos, pero también provocar despidos y redefinir el proceso creativo.

Connor Leahy, de Conjecture, y Julia Smakman, del Ada Lovelace Institute, coincidieron en que las salvaguardas técnicas no son suficientes. Piden leyes claras que restrinjan el uso dañino de modelos que permiten crear videos generados por IA.